引言:为什么AI Agent需要记忆?

在使用 ChatGPT、Claude 等大语言模型时,你是否遇到过这样的困扰:每次开启新对话,AI 都像是”失忆”了一样,完全不记得你们之前的交流内容。你不得不一遍遍地重复自己的背景、偏好和需求。这种”金鱼记忆”严重限制了 AI 成为真正的个人助手。

为了让 AI Agent 能够像人类一样持续学习和成长,我设计并实现了一套三层记忆模型。这套系统灵感来源于认知科学中的人类记忆机制,让 AI 能够记住用户的身份信息、偏好设置、重要事实,甚至是跨会话的长期知识。

三层记忆架构:模仿人类认知

人类的记忆系统分为工作记忆(短期保持信息)、短期记忆(近期事件)和长期记忆(持久知识)。借鉴这一理念,我结合openclaw的设计复现了 AI 记忆系统包含以下三层:

第一层:工作记忆(Working Memory)

工作记忆是 AI 的”临时工作台”,存储当前对话会话中的完整上下文。它就像人类的意识焦点,让 AI 能够理解和回应用户当前的输入。

核心特性:

- 完整对话记录:保存当前会话中所有的用户输入和 AI 回复

- Token 限制管理:监控上下文长度,避免超出模型处理极限

- 实时访问:AI 可以立即获取当前会话的所有信息

实现代码示例:

|

第二层:短期记忆(Short-term Memory)

当工作记忆变得过于庞大时,短期记忆发挥作用。它会将旧的对话压缩成摘要,提取关键要点,让 AI 在不丢失重要信息的前提下,高效处理长对话。

核心特性:

- 对话摘要:将冗长的对话压缩成精炼的总结

- 关键要点提取:识别并保存对话中的重要信息点

- 用户意图追踪:记录用户在会话中的主要目标和需求

应用场景:当你与 AI 进行了 50 轮深入的技术讨论后,AI 仍然能够准确回顾你们讨论的核心问题,而不需要重新阅读全部对话。

第三层:长期记忆(Long-term Memory)

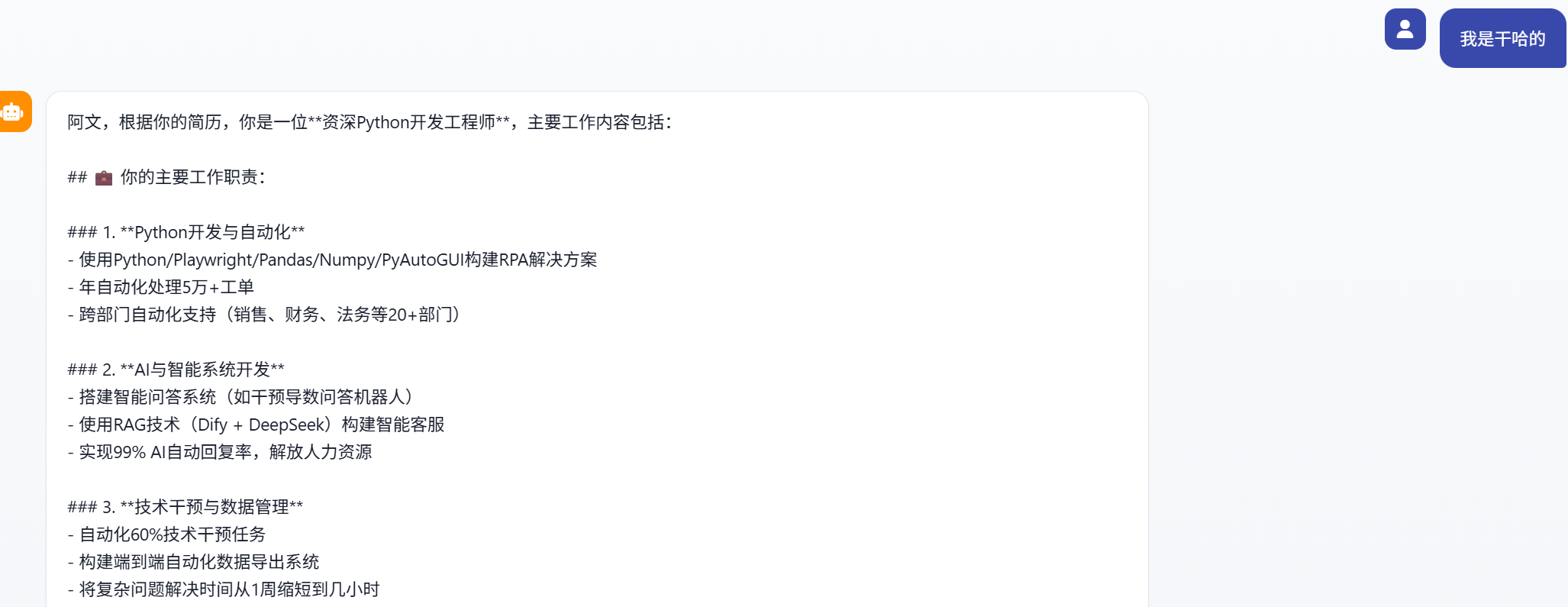

长期记忆是这套系统的精髓。它允许 AI 跨会话记住用户的信息,形成持久的用户画像。这是让 AI 从”工具”转变为”伙伴”的关键。

我设计了七种记忆类别:

| 类别 | 图标 | 说明 | 示例 |

|---|---|---|---|

| identity | 👤 | 身份信息 | “用户叫阿文,是一名软件工程师” |

| preference | ⭐ | 偏好设置 | “用户喜欢简洁的回答” |

| fact | 📌 | 重要事实 | “用户正在开发一个 AI Agent 项目” |

| lesson | 📚 | 经验教训 | “上次用 Python 3.9 遇到了兼容性问题” |

| goal | 🎯 | 目标计划 | “用户计划在三个月内上线产品” |

| relationship | 👥 | 关系信息 | “用户的团队成员有小明、小红” |

| instruction | 📜 | 指令要求 | “请总是用中文回复” |

当AI学习了在去问就会基于历史的会话来回答记忆中的内容

智能记忆提取:自动识别重要信息

最酷的功能是自动记忆提取。系统会分析每一轮对话,自动识别值得记住的信息,无需用户显式告知。

支持的自然语言模式

1. 主动记忆请求

|

2. 身份信息识别

|

3. 偏好信息提取

|

4. 指令要求捕获

|

实现原理:使用正则表达式模式匹配 + LLM 分析,从对话中智能提取结构化记忆。

记忆注入:让 AI 拥有上下文感知

提取的记忆如何影响 AI 的回复?答案是记忆注入。在每次对话开始前,系统会自动将相关记忆注入到系统提示(System Prompt)中:

|

这样,AI 在每次回复时都能考虑到用户的背景和偏好,真正做到个性化服务。

技术实现:Markdown 存储 + 优先级管理

Markdown 格式存储

长期记忆采用 Markdown 文件存储,便于人工查看和编辑:

|

记忆优先级

不是所有记忆都同等重要。系统为每条记忆设置 1-5 级重要性:

- ⭐⭐⭐⭐⭐ 身份信息(最高优先级)

- ⭐⭐⭐⭐ 指令要求

- ⭐⭐⭐ 重要事实、偏好设置

- ⭐⭐ 经验教训

- ⭐ 临时信息

在记忆注入时,系统会优先加载高优先级的记忆,确保在有限的上下文窗口中保留最关键的信息。

应用场景:一个真实的对话示例

让我演示这套记忆系统的实际效果:

第一次对话(新用户)

|

第二次对话(跨会话)

|

第三次对话(更深层的个性化)

|

与其他技术的结合

与 LangGraph 的集成

|

与 MCP 服务的协同

记忆系统与 MCP(Model Context Protocol)服务无缝协作。当 AI 调用外部工具时,记忆上下文会被一同传递,确保工具调用也能享受个性化服务。

未来展望

这套记忆系统还有很大的进化空间:

- 记忆向量化:使用向量数据库存储记忆,支持语义检索

- 记忆遗忘机制:模拟人类的遗忘曲线,自动清理过时记忆

- 跨用户记忆:识别用户群体间的共性,提供群体智能

- 记忆可视化:为用户提供记忆管理界面,查看和编辑 AI 记住的内容

结语

记忆是智能的基石。没有记忆,AI 只能是一次性的工具;有了记忆,AI 才能成为真正理解你、陪伴你的智能伙伴。

这套三层记忆模型已经在我的 LangGraph Agent 项目中落地运行,让 AI 助手从”金鱼”进化成了”知己”。如果你也对构建有记忆的 AI 感兴趣,欢迎一起交流探讨!

相关技术栈:

- LangGraph - 工作流编排

- LangChain - LLM 应用框架

- Python 3.11+ - 开发语言

- Markdown - 记忆存储格式

参考项目:

- OpenClaw - 开源的记忆增强型 AI 助手

- MemGPT - 虚拟上下文管理

评论

0 条评论